摘要: DeepMind 的最新研究成果,對廣泛使用於語音識別、圖像識別、語義理解等領域的深度學習人工網絡RNN性能帶來顯著提升(substantially better )。研究主要在記憶時序生成模型上用了外部記憶來增強,對深度學習領域的研究有一定啟發。作者介紹,新提出的模型可用在 Introspection Network、神經圖靈機、Least-Recently Used access mechanism (LRU) 和可差分神經計算機(DNC) 。

在新智元微信公眾號回復170218,可下載論文。

DeepMind 的研究員們15日在arXiv 上傳了一篇論文,名為《記憶時序生成模型》的論文,自稱新的模型能在性能上比現在被廣泛使用的RNN,比如LSTM ,有顯著的提升。

論文作者包括:Mevlana Gemici, Chia-Chun Hung, Adam Santoro, Greg Wayne,Shakir Mohamed, Danilo J. Rezende, David Amos, Timothy Lillicrap 。這是DeepMind內部專攻通用人工智慧的研究小組。

在論文摘要中,作者寫道:

論文使用遠程依賴(long-range dependencies)來解決時序數據建模中的一般問題。在這個研究中,基於時序的間隔和過去的觀察,新的觀察是完全可預測或部分可預測的。

足夠有效的時序模型應該可以將序列的可預測元素和不可預測元素分開,對不可預測元素標示不確定性,並且快速識別可以幫助預測未來的新元素。

為了創建這樣的模型,DeepMind 的研究者們提出了一種使用外部記憶系統增強的時序生成模型。它們是在變分推理(variational inference )框架下開發的,提供了實用的訓練方法和深入了解模型運作的方法。研究展示了一系列稀疏的、遠程時序依賴問題,這些模型從序列的早期階段開始存儲信息,並能有效地對已存儲的信息進行再利用。

最終,新的模型在實驗中比現有的基於遞歸神經網絡(如 LSTM)的模型在性能上有顯著的改進。

那麼,這一研究有何意義?我們先來看看RNN是什麼。

維基百科上的介紹是,循環神經網絡(RNN)是人工神經網絡的一種,網絡中的單元之間的連接形成有向循環。這創建了網絡的內部狀態,允許其展現動態時間行為。與前饋神經網絡不同,RNN可以使用其內部存儲器來處理任意序列的輸入。

常規網絡可以將輸入和輸出以向量對向量(無時間維度)的方式進行關聯。而循環層的引入將其擴展到了序列對序列的匹配。從而產生了one to one右側的一系列關聯方式。較為特殊的是最後一個many to many,發生在輸入輸出的序列長度不確定時,其實質兩個循環網絡的拼接使用,公共點在紫色的隱藏狀態ht+1ht+1。

具體應用上:

-

many to one:常用在情感分析中,將一句話關聯到一個情感向量上去;

-

many to many:第一個many to many在DNN-HMM語音識別框架中常有用到;

-

many to many(variable length):第二個many to many常用在機器翻譯兩個不同語言時。

正如上文提到,RNN在當下的深度學習技術中有著非常廣泛的應用,從最早的手寫字體識別,到後來的語音識別,再到機器翻譯等等。

不過,RNN 自身也有一些缺陷,原因在於梯度消失(vanishinggradient)和梯度爆炸(exploding gradient)問題,由此,在研究中也延展出了許多新的模型,比如長短記憶網絡和門網絡等等。目前常見的RNN架構可以分為以下幾種:

-

Fully recurrent network

-

Recursive neural networks

-

Hopfield network

-

Elman networks and Jordan networks

-

Echo state network

-

Neural history compressor

-

Long short-term memory

-

Gated recurrent unit

-

Bi-directional RNN

-

Continuous-time RNN

關於生成記憶模型

在DeepMind 的這一研究是基於一種被稱為生成記憶模型(Generative Temporal Models )的架構,其中的一大亮點是使用了外部的記憶來增強網絡。

在論文中,作者寫道:我們在機器翻譯應用中使用的許多數據集具有序列性,此外,無論是自然語言、語音處理數據、高清晰度的視頻流、醫療診斷中縱向的時間序列數據,還是天氣預報中的時空數據。

生成記憶模型對於這些應用來說是必需的。生成記憶模型對於智能代理來說也是重要組件,因為它們允許虛擬推理、物理預測、機器人本地化和在其他領域的基於模仿的規劃。

這些任務要求了帶有高水平的觀測序列、並包含了複雜的、具有長程依賴性的模型,大部分現有GTM是無法達到要求的。研發達到上述要求的GTM是他們此項研究的一個大目標。

許多GTM€€€€無論他們是線性的還是非線性的、確定的還是隨機的€€€€假設了潛在的時間動態是由低序馬爾科夫遷移主導並使用了固定維度的充足數據。這樣的模型有隱馬爾科夫模型和像卡爾曼濾波器這樣的線性動態系以及它們的非線性擴展。使用在這些模型中的定序馬爾科夫假設對於描寫許多實際相關的系統是不夠的。Bialek在數量上論證了馬爾科夫假設無法描寫長程相關的物理系統,對文獻中長距離相關性的部分也無法準確描寫。那些去長程、多序的記錄中獲取信息的模型,比如循環神經網絡,在這方面比限制在定序馬爾科夫假設的模型要有顯著優勢。

許多最近提出的GTM,比如變量循環神經網絡(VRNN)和深度卡爾曼濾波器,建立在廣為人知的循環神經網絡基礎上,比如長短記憶網絡 Long Short-Term Memory (LSTM) (Hochreiter and Schmidhuber, 1997) 和 Gated Recurrent Units (GRUs) (Chung et al., 2015a)。

原則上,這些循環網絡可以解決變序馬爾科夫問題,比如設計新增動態以存儲和保護長程信息。實踐中,當要求更高的存儲容量時,它們表現很差。這些RNN是典型的密集聯接,因此模型的參數複雜性會隨著存儲容量成二次方增長。再有,它們的循環動態必須服務於兩個相互競爭的角色:一方面必須穩定地存儲信息以供未來的提取,另一方面必須進行相關計算以提取即刻使用的信息。這些限制指向了對於將記憶存儲從計算中區分出來的RNN的需要。

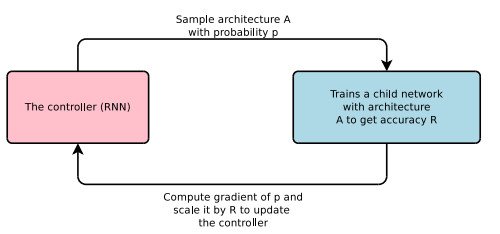

DeepMind的研究者證明了GTMM有更強的解決複雜、長程依賴性任務的能力。他們研發了一個通用結構,研究了四種使用不同類型存儲系統的情況。這四個模型展示出不同的存儲系統是如何適應不同類型的序列結構,以及對於成功建模、有效數據和生產質量的影響。

他們首先描述了設計generative temporal models的一般方法,並進行了幾個不同的推斷(第二部分)。然後,基於一系列為凸顯給長程依賴性信息建模的不同問題而設計的視覺序列任務,比較了GTMM和VRNN。最後,大踏步地邁向為在三維環境中更富有理解能力的模型評級。

作者寫道,在這一過程中,主要有以下技術貢獻:

我們研發了帶存儲的產生模型的通用結構。這一結構使得我們可以發展基於我們存儲系統的GTMM:一個新型位置存儲結構,可用在 Introspection Network、神經圖靈機, Least-Recently Used access mechanism (LRU) ,可差分神經計算機(DNC) 。

-

我們論證了變量推斷可以較容易地訓練能夠處理導向最先進的時間VAE的高維度輸入流。

-

我們論證了我們的新模型完勝現有最先進的基於多任務(從複製任務的變體到長時間延遲後的準確回溯)的模型

-

我們論證了我們的GTMM能夠為實際的3D環境建模,並展示了這些模型可以抓取物理和時間連貫性上的重要部分,例如在封閉的環形中連貫地產生第一人稱視角。

研究結果

在7個任務上測試了我們的模型,測試它們的學習能力和對有複雜依賴性的時序數據進行預測的能力。這些任務涉及圖像序列建模,並提供演繹、空間推理和一次性生成(one-shot generalisation)的測試。下面為每個任務提供了示例訓練序列。

任務中的樣本序列 :pre-recall interval l = 20 , recall interval k = 5。

在奇偶校驗調用任務中,調用的區間由標誌每個初始圖像k的均勻性或奇數性圖像組成。

對於一次性調用任務,在測試時間的序列是用訓練期間未使用的一組符號創建的。即便如此,完美的調用仍然是可能的。

在index-and-recall之後的動態依賴性任務的訓練序列,其中每個圖像里的數字提供序列次序中下一個數字的位置參考

相似性提示回憶任務的示例訓練序列。

隨機遊走動作序列及在每個位置上發現的圖像被提供給模型。在邊界處,動作序列被限制在邊界內。每個動作作為一個條件變量提供給生成模型,而不是自己建模。

30個時間步長原地交替的訓練序列,該周期直到重複到約15個步長為止。

轉貼自: 壹讀

留下你的回應

以訪客張貼回應